Meta’s Superintelligence Labs lanzó su primer modelo de IA generativa, llamado Muse Spark, a principios de esta semana. Actualmente está disponible a través de la aplicación Meta AI, pero la empresa planea integrar Muse Spark en todas sus plataformas, incluidas Facebook, Instagram y WhatsApp, en las próximas semanas.

Meta afirma que Muse Spark, en parte, se diseñó para responder mejor a las preguntas de la gente sobre su salud. La empresa incluso ha trabajado con "más de 1,000 médicos para recopilar datos de formación que permitan respuestas más objetivas y exhaustivas", según el blog de Meta.

Cómo funciona

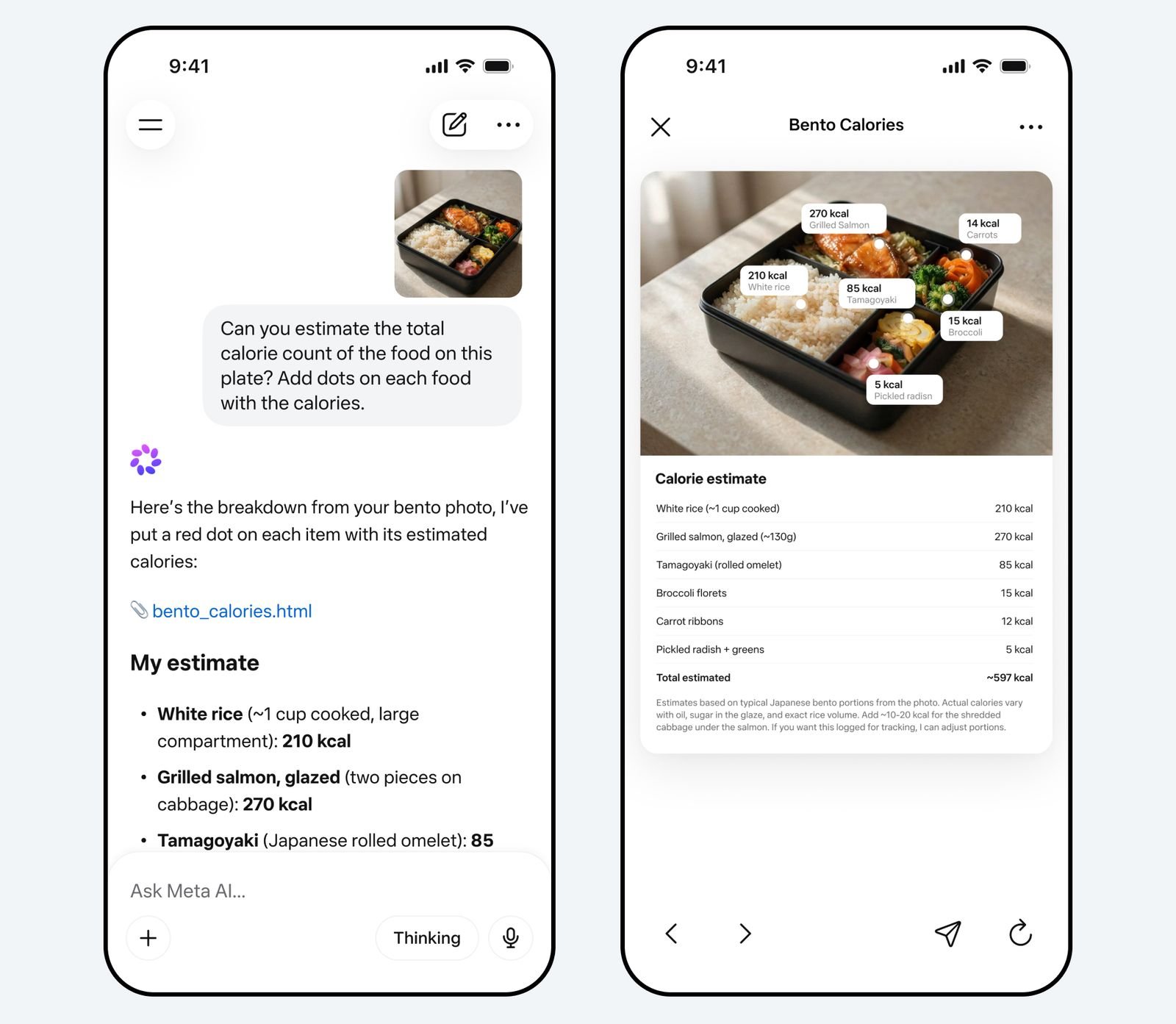

Mientras el nuevo modelo se extiende a millones de usuarios, probé Muse Spark para ver cómo respondía a preguntas relacionadas con la salud. Cuando le pregunté en qué podía ayudarme, el robot enumeró algunos usos básicos, como la creación de una rutina de ejercicios o la generación de preguntas para mi médico, pero destacó una petición directa de mis datos de salud:

"Pega tus cifras de un monitor de fitness, un glucómetro o un informe de laboratorio. Calcularé las tendencias, identificaré patrones y los visualizaré", se lee en la salida de Meta AI. "Ejemplo: 'Estas son mis últimas 10 lecturas de presión arterial: ¿hay algún patrón?'".

Meta no es la única que anima a los usuarios a cargar sus datos sanitarios. Tanto ChatGPT, de OpenAI, como Claude, de Anthropic, tienen modos de chatbot diseñados específicamente para ayudar a los usuarios a entender su salud y tomar decisiones. Por ejemplo, puedes abrir Claude y conectarlo a tus datos de salud de Apple o Android con solo pulsar un botón dentro de la aplicación. Claude utilizará esa información como parte de sus respuestas. Google también te permite subir datos médicos a Fitbit para que los analice su entrenador de salud con IA.

Problemas de seguridad

Entregar este tipo de datos a cualquier herramienta de IA es una decisión arriesgada, incluso si los usuarios son capaces de generar consejos personalizados. "El uso de estos modelos puede ser realmente delicado", afirma Monica Agrawal, profesora adjunta de la Universidad de Duke y cofundadora de Layer Health, una plataforma de IA para que los hospitales examinen los historiales médicos. Añade: "Cuanta más información le des, más contexto tendrá sobre ti y, potencialmente, podrá ofrecer mejores respuestas. Pero en el lado opuesto, compartir tus datos de salud sin protecciones plantea grandes problemas de privacidad".

A Agrawal le preocupa que los usuarios suban datos confidenciales a los chatbots, ya que estas herramientas de IA de uso común no cumplen las protecciones de la HIPAA, la ley estadounidense histórica que protege a los pacientes de la exposición de su información sanitaria confidencial. Layer Health cumple la HIPAA. Se trata de un alto estándar de privacidad que la gente está acostumbrada a experimentar durante las visitas al médico. La información que alguien comparte con un bot está mucho menos regulada, incluso si se trata de los resultados de su laboratorio clínico.

Todo lo que compartas en un chat con Meta AI puede almacenarse y utilizarse para entrenar futuros modelos de IA. "Conservamos los datos de entrenamiento durante el tiempo que necesitemos, caso por caso, para garantizar que un modelo de IA funciona de forma adecuada, segura y eficiente", reza la política de privacidad de Meta sobre la IA generativa. Meta también ha declarado que puede adaptar la publicidad a los usuarios en función de sus interacciones con las funciones de IA.